De morele architecten van AI: geen halfgoden, maar ook geen code monkeys

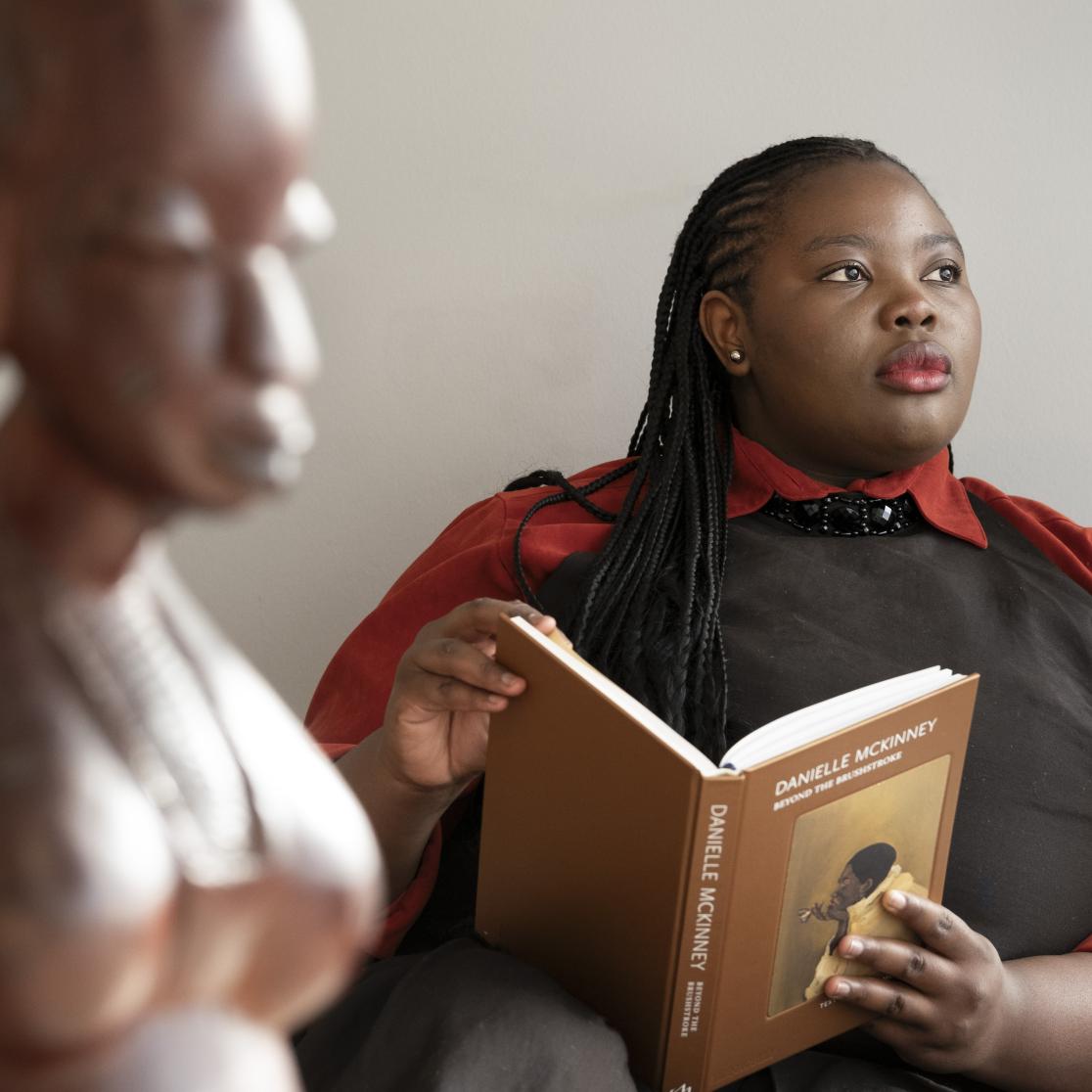

Wie krijgt de schuld als AI de verkeerde kant opgaat? En wie is er verantwoordelijk voor het voorkomen van eventuele negatieve gevolgen? In haar proefschrift "A Showing of Hands: Making Visible the Ethical Agency of AI Developers" richt Tricia Griffin zich op de mensen achter de technologie en de clichés. Volgens Griffin moeten we deze mensen zien als professionals die morele keuzes maken via hun code.

Dus, als de machines ooit de macht grijpen, wiens schuld is dat dan eigenlijk geweest? “Laten we de hype wat temperen. De apocalyps van volledig ontwikkelde robots staat echt niet voor de deur. We zouden er allemaal goed aan doen ons te realiseren dat tech-CEO’s er financieel veel baat bij hebben als ze doen alsof Artificial General Intelligence (AGI) om de hoek ligt – zolang ze daarmee maar een nieuwe smak investeringsgeld binnenhalen,” legt Tricia Griffin uit, kort nadat ze haar proefschrift over de ethische handelingsvrijheid van AI-ontwikkelaars heeft verdedigd. “Maar ingenieurs die al jarenlang in de robotica werken, zijn het erover eens: dat punt hebben we nog lang niet bereikt. En als we dan toch met de vinger willen wijzen, moeten we echt een genuanceerdere blik ontwikkelen.”

Verantwoordelijkheid in AI

Griffin maakt een onderscheid tussen degenen die verantwoordelijk zijn (dat wil zeggen: wettelijk aansprakelijk en onderworpen aan democratische controle) en een bredere groep van mensen die rekenschap zouden moeten afleggen. Om verschillende praktische redenen is ze het ermee eens dat de juridische verantwoordelijkheid bij de bedrijven of CEO’s die AI-systemen inzetten moet liggen. Maar ze betoogt dat AI-ontwikkelaars, als morele actoren, wél verantwoordelijk gehouden moeten worden voor de keuzes die ze maken.

“We moeten hier niet te cynisch over doen,” zegt Griffin, die voor haar promotieonderzoek meer dan veertig hooggeplaatste AI-ontwikkelaars interviewde. “We moeten onderscheid maken tussen het clichébeeld van een groep machtige, arrogante CEO’s en de mensen die daadwerkelijk de code schrijven. Hoewel die laatsten hun werk deels compartimentaliseren, heb ik gemerkt dat zij zich er wél van bewust zijn dat ze ethisch handelingsvermogen hebben en dat ze daar dilemma’s over ervaren.”

Tricia Griffin is docent Global Health, Biomedical Ethics, AI Ethics aan de Faculty of Health, Medicine & Life Sciences. Ze promoveerde aan de Faculty of Science and Engineering. Lees meer en bekijk haar verdediging.

Doet de moraal van één enkele ontwikkelaar ertoe?

Hier stuiten we op het probleem van vele handen, oftewel de moeilijkheid om schuld aan te wijzen in situaties waarin meerdere personen bijdragen aan een resultaat. Dit is onvermijdelijk bij AI-ontwikkeling, waarbij mogelijk honderden mensen bijdragen aan een product. Dat betekent echter niet dat het individu wordt vrijgepleit: “Het zijn altijd individuele ontwikkelaars die het werk uitvoeren. Toch worden zij niet echt ter verantwoording geroepen voor hun keuzes, en omdat de samenleving hen niet serieus neemt als morele actoren, voelen zij ook geen verplichting om zichzelf serieus te nemen.

Aangezien AI en automatisering gebaseerd zijn op toezicht en het verzamelen van enorme hoeveelheden data, bevinden ontwikkelaars zich volgens Griffin in een fundamenteel manipulatieve relatie met het publiek. En met de enorme geldstromen die ermee gemoeid zijn, zit de industrie vol met perverse prikkels die manipulatie aanmoedigen ten dienste van maximale winst. “Het is in het belang van bedrijven om ontwikkelaars te behandelen als ‘code-monkeys’, vervangbare pionnen die het werk doen zonder na te denken over het grotere geheel of ethische vragen te stellen die ten koste zouden kunnen gaan van de winst of de race om data te verzamelen.”

Elke programmeur maakt moeilijke ethische keuzes

Griffin hield aan haar onderzoek niet alleen bewondering over voor de vaardigheden van ontwikkelaars, maar ook veel begrip voor de moeilijke dilemma’s waarmee ze worden geconfronteerd. Vaak in hun eentje en zonder voldoende voorbereiding. “Ontwikkelaars kunnen óf opstappen, óf hun toevlucht nemen tot ‘malicious compliance’: bewust slecht werk leveren of beweren dat een onethisch verzoek technisch niet haalbaar is. Natuurlijk kunnen ze ook klokkenluider worden, maar dat betekent vaak dat ze hun verdere carrière, en daarmee aanzien en inkomen, moeten opgeven.”

Griffin herinnert zich het voorbeeld van een ontwikkelaar die een weg moest vinden tussen eerlijkheid en veiligheid, en probeerde tot een compromis te komen zonder goed te begrijpen wat de gevolgen van die afweging waren. “Veel van de professionals die ik sprak, waren zich wel degelijk bewust van de ethische dimensie van wat hen gevraagd werd, maar beschikten niet over de juiste middelen of toegang tot een sterk netwerk om echt verantwoorde beslissingen te kunnen nemen. Ik denk dat de academische wereld hierin een betere rol moet spelen. Cursussen in ethiek worden nu vaak als bijzaak aan het curriculum toegevoegd en te theoretisch aangeboden. Tegelijkertijd hebben we werkplekken nodig waar ruimte is voor ethische gesprekken, in plaats van ontwikkelaars in het ongewisse te laten.”

Zijn mensen weerloos tegenover AI-bedrijven?

Deze vraag roept een bredere maatschappelijk vraag op: waarom worden AI-ontwikkelaars niet op dezelfde manier gereguleerd als bijvoorbeeld artsen of advocaten? Dat zijn beroepen met duidelijke ethische codes en strikte regels, juist omdat hun cliënten, net als het brede publiek in het geval van AI, volledig afhankelijk zijn van specialistische vakkennis. “Ontwikkelaars zouden zich ervan bewust moeten zijn hoe kwetsbaar de mensen zijn van wie ze data verzamelen. En ook hoe kwetsbaar de mensen zijn op wie hun systemen worden toegepast. Er bestaat een aanzienlijke disbalans in machtsverhoudingen.

Griffin verwijst naar het toeslagenschandaal dat leidde tot de val van het kabinet-Rutte III in Nederland. “Je kon je kind kwijtraken omdat een rechter afging op wat een algoritme zei, in plaats van op het werkelijke bewijs. Maar iemand heeft dat algoritme geprogrammeerd, en de parameters zo ingesteld dat alleenstaande moeders en mensen met een niet-Nederlandse naam eerder als fraudeur werden aangemerkt. En toch hebben we het nooit gehad over de rol van die ontwikkelaars in het publieke debat over deze affaire.”

Zijn morele ontwikkelaars machteloos tegenover het systeem?

Hoewel AI-ontwikkelaars sterk in trek zijn op de arbeidsmarkt, hebben ze als groep weinig politieke macht. Praten over vakbondsvorming voelt bijna overbodig voor een beroepsgroep die toch al profiteert van wat collectieve onderhandelingen traditioneel opleveren: hoge salarissen, goede arbeidsvoorwaarden en prima werkplekken. De ethische dimensie van arbeid vormt hier een relatief nieuw terrein. “Zonder politieke organisatie of collectieve onderhandeling is het ethisch ‘shoppen’ voor bedrijven, uiteindelijk heeft bijna iedereen zijn prijs. En het feit dat ontwikkelaars vaak maar een klein onderdeel van een systeem bouwen, biedt genoeg speelruimte om zich achter aannemelijke ontkenning te verschuilen en gewoon mee te gaan in het geheel.”

Zodra AI-ontwikkelaars zichzelf gaan zien als morele actoren, op een manier die verder gaat dan hun functieomschrijving, hebben ze ook een gemeenschap nodig van gelijkgestemden die elkaar kunnen ondersteunen. “Op conferenties draait het bij presentaties van modellen vooral om technische scherpte; ethiek is binnen het vakgebied totaal geen prestigeonderwerp. Ontwikkelaars gebruiken hun technische verbeeldingskracht om deze systemen te bouwen, ze zouden diezelfde verbeeldingskracht ook kunnen inzetten om na te denken over de mogelijke schadelijke gevolgen van hun modellen, en over hoe die kunnen worden beperkt.”

Hoe word je goed in moreel programmeren?

Griffin vindt ook dat studenten al tijdens hun opleiding samen zouden moeten reflecteren op praktische ethiek en daarin kunnen groeien. “Ontwikkelaars moeten begrijpen dat ethiek niet simpelweg gezond verstand is. Als je echt goed wilt worden in het onderscheiden van goed en fout, moet je daar moeite voor doen, net zoals bij elke andere vaardigheid. Als je je wilt specialiseren in eerlijkheid, ontdek je al snel dat er minstens zes verschillende definities van zijn die je niet allemaal tegelijk wiskundig kunt waarmaken. Een expert worden op het gebied van eerlijkheid vraagt om een gemeenschap van mensen die het belangrijk vinden om dat écht goed te doen.”

Over het algemeen ziet Griffin ook positieve ontwikkelingen. “Nu AI overal is, worden mensen zich steeds bewuster van kwesties rond privacy, en beginnen ze manieren te zoeken om zich daartegen te verzetten. Ik denk dat je heel enthousiast kunt zijn over deze technologie, en tegelijkertijd tégen de grove, ontmenselijkende, kapitalistische uitbuiting van onze data. Maar daar is wel een beweging voor nodig, en AI-ontwikkelaars moeten daar een wezenlijk onderdeel van uitmaken.”

Tekst: Florian Raith

Lees ook

-

Thomas Cleij herbenoemd als decaan van de Faculty of Science and Engineering

Het College van Bestuur van de Universiteit Maastricht herbenoemt prof. dr. Thomas Cleij als decaan van de Faculty of Science and Engineering. Thomas zal tot maart 2031 leiding blijven geven aan de faculteit.

-

Nationale inspiratiegids over trainingen in maatschappelijke betrokkenheid toont SciCom Incubator van FSE

Een nieuwe inspiratiegids laat zien hoe trainingen onderzoekers helpen om maatschappelijke betrokkenheid in hun carrière te integreren. De gids is gebaseerd op voorbeelden van vijf universiteiten.

-

Suzie: "Ik lig wakker van wat er in mijn thuisland gebeurt"

Suzie Nzekui strijdt vanuit Maastricht voor vrouwen in haar thuisland Kameroen. Met haar feministische vrouwencollectief én haar master Systems Biology and Bioinformatics werkt ze aan betere gezondheidszorg.