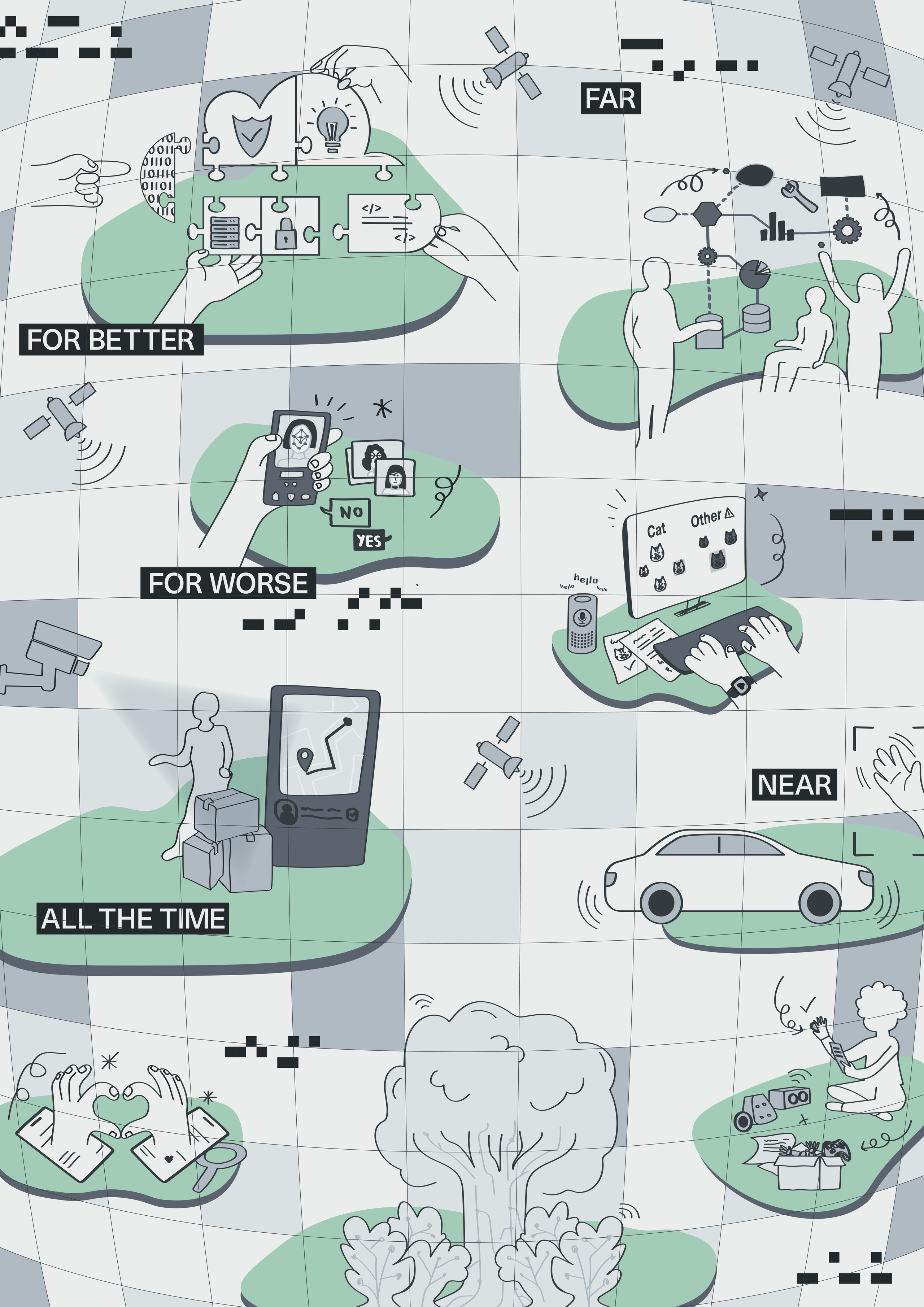

Nieuwe technologieën: Helden of schurken?

Zijn nieuwe technologieën een zegen of een vloek? Utopisch of dystopisch? Goed of slecht? De media staan vol met tegenstrijdige berichten over kunstmatige intelligentie, zelfrijdende auto's, cryptocurrency en virtual reality. Van invloedrijke publieke figuren tot techjournalisten en politici – de meningen lopen sterk uiteen. Maar hoe voorkomen we dat we meegesleurd worden in de hype en tegelijkertijd te cynisch worden?

Dani Shanley, Universitair Docent filosofie, onderzoekt waarom technologie vaak als held of schurk wordt gezien. Ze richt zich op de vraag hoe technologie op een verantwoorde manier ontwikkeld kan worden en wat dit betekent voor onze opvattingen over verantwoordelijkheid.

Meer dan een checklist

Volgens Dani werd het concept van verantwoorde innovatie tussen 2010 en 2020 steeds populairder in beleidsdiscussies en financieringsprogramma's. Maar het blijft lastig te definiëren wat 'verantwoord' precies betekent. “Beleidsmakers, zoals in de Europese Commissie, stellen vaak concrete kaders op: gedragscodes, diversiteitsbeleid en ethische richtlijnen. Deze worden opgelegd als eisen waaraan onderzoekers moeten voldoen. Academici nemen daarentegen een breder filosofisch perspectief in. Zij vragen zich niet alleen af of onderzoek ethisch is, maar ook hoe onderzoeksagenda's worden bepaald en wie daarin een stem heeft.”

Dani waarschuwt dat verantwoorde innovatie soms gereduceerd wordt tot een simpele checklist. “Verantwoord handelen gaat verder dan naleving; het vereist een voortdurende dialoog en reflectie over de impact van wat je doet.” Vooral in de privésector, waar bedrijven onafhankelijk opereren, kunnen ethische overwegingen op de achtergrond raken. “Wanneer bedrijven onderzoek financieren, hoeveel vrijheid hebben onderzoekers dan om kritische vragen te stellen? En kunnen zij ethische zorgen uiten zonder hun financiering te riskeren?”

Wie heeft inspraak?

Dani werkt samen met ingenieurs en AI-ontwikkelaars, voornamelijk via haar samenwerking met collega's van het Department of Advanced Computing Sciences (DACS) van de Faculty of Science and Engineering (FSE) en in haar rol bij het Brightlands Institute for Smart Societies (BISS), om ethische overwegingen een integraal onderdeel van technologische innovaties te maken. “Veel innovators willen daadwerkelijk bijdragen aan de maatschappij, maar ethiek komt vaak pas laat in het ontwikkelingsproces aan bod. Tijdgebrek en strakke deadlines maken het moeilijk om stil te staan bij de bredere implicaties. Maar hoe eerder ethische reflectie wordt meegenomen, hoe makkelijker het is om technologie verantwoord te sturen.”

Een andere uitdaging is ervoor te zorgen dat technologische oplossingen daadwerkelijk voorzien in de behoeften van degenen voor wie ze bedoeld zijn. “Ontwikkelaars bedenken oplossingen gebaseerd op hun eigen aannames. Maar als de doelgroep niet wordt betrokken bij het proces, kunnen innovaties hun doel missen. Wie definieert eigenlijk het probleem dat een technologie moet oplossen? Wat is de positieve verandering die ze denken te bereiken door een bepaalde technologie te ontwikkelen? Wie wordt er eigenlijk geraakt door het probleem in kwestie? Zijn zij meegenomen in de probleemdefinitie? Kunnen ze ook worden betrokken bij andere stadia van het ontwikkelingsproces? Innovatie zou niet alleen gericht moeten zijn op wat technisch mogelijk is, maar ook op wat maatschappelijk wenselijk is”, benadrukt Dani.

De verborgen risico's van technologie

Technologische vooruitgang gaat vaak gepaard met een hype, met grote beloften over hoe innovaties de maatschappij zullen veranderen. Maar, “hoewel optimisme vooruitgang kan stimuleren, kan het ook leiden tot onrealistische verwachtingen en verkeerde informatie,” beweert Dani. “Generatieve AI wordt bijvoorbeeld gepresenteerd als revolutionair, maar de impact ervan is verre van onschuldig: van milieuschade en vooringenomen algoritmes tot misinformatie en uitbuiting van arbeidskrachten.”

“De invasie van AI in oorlogsvoering heeft niet alleen de vernietiging gemechaniseerd, maar heeft ook de verantwoordelijken verwijderd van de gevolgen ervan. Nergens is dit duidelijker dan bij het gebruik van het Israëlische programma Lavender, een AI-gestuurd systeem dat met automatisering doelen aanwijst in Gaza. Hoewel het werd gepresenteerd als een efficiënt hulpmiddel, bleek het duizenden Palestijnen te markeren als bedreiging op basis van ondoorzichtige criteria. In plaats van nevenschade te verminderen, droeg het bij aan een hoog aantal burgerslachtoffers. Dit laat zien hoe de illusie van algoritmische precisie verantwoordelijkheidsgevoel kan ondermijnen.”

Ook in de gezondheidszorg kunnen technologieën onbedoelde gevolgen hebben. “Ik zag ooit een prototype van een robot die borstonderzoeken uitvoert. Het idee was om het tekort aan verpleegkundigen te compenseren. Maar een machine mist de empathie en geruststelling van een mens. Een verpleegkundige leest lichaamstaal, stelt gerust en reageert op onuitgesproken angsten. Als we zorg automatiseren onder het mom van efficiëntie, lopen we het risico dat we de gezondheidszorg aanpassen aan machines in plaats van aan mensen.”

Deze voorbeelden illustreren hoe beloftes over de toekomst vaak de werkelijke schade verbergen die veroorzaakt wordt door prioriteit te geven aan technische oplossingen, in plaats van maatschappelijke problemen. “We moeten de hulpmiddelen die we gebruiken kritisch onder de loep nemen in een wereld waarin de regelgeving de technologie nog niet heeft ingehaald. Beslissen of we deze hulpmiddelen gaan gebruiken, en op welke manier, is een verantwoordelijkheid die we allemaal zouden moeten nemen.”

Het recht om ‘nee’ te zeggen

Vaak wordt technologische vooruitgang voorgesteld als een onvermijdelijke ontwikkeling, maar is dat wel zo? “Als een technologie discriminatie in stand houdt, privacy schendt of menselijke interactie vermindert, moeten we dan niet het recht hebben om die te weigeren?” vraagt Dani. “Door de geschiedenis heen hebben activisten en wetenschappers technologische ontwikkelingen uitgedaagd en hervormd. Denk aan AI-gezichtsherkenning die mensen van kleur onevenredig verkeerd identificeert; protesten hiertegen hebben geleid tot strengere regelgeving en in sommige gevallen verboden op het gebruik van deze technologie. Erkennen dat innovatie geen eenrichtingsverkeer is, kan helpen om individuen en gemeenschappen in staat te stellen om technologische vooruitgang vorm te geven op manieren die aansluiten bij maatschappelijke waarden. We moeten ervoor zorgen dat technologieën worden ontwikkeld om de mensheid te dienen en niet andersom.”

Volgens Dani kunnen onderwijsinitiatieven bijdragen aan een ethisch bewuste technologische ontwikkeling. “Bij ons werk met ingenieurs en datawetenschappers proberen we ethiek te integreren in de opleiding. In plaats van ethiek als een extra vak te behandelen, moet het een fundamenteel onderdeel zijn van technologische innovatie.”

Tekst door: Eva Durlinger

Afbeeldingen door: Claire Gilissen en Joudi Bourghli

Lees ook

-

Tussen nuance en nieuws: hoe wetenschap en journalistiek elkaar vinden in Limburg

Wat betekenen wereldgebeurtenissen voor mensen in de regio? En hoe vertaal je complexe academische kennis naar een begrijpelijk verhaal voor een breed publiek?Researchers

-

Hoe mooi mag een vervuild landschap zijn?

Wie langs de meanderende Geul wandelt, ziet een ansichtkaart. Glooiende hellingen, vakwerkhuizen, grazende koeien, een watermolen die het landschap ritme geeft. Maar onder dat idyllische beeld schuilt een ongemakkelijke realiteit.Researchers

-

Onderzoek naar de keukentafel brengen

In samenwerking met Studio Europa Maastricht vertaalde Katleen Gabriels haar onderzoek naar kinderen en Snapchat in een policy brief die academie en beleid verbindt. Het initiatief toont hoe UM onderzoek structureel omzet in maatschappelijke impact in Brussel, Den Haag en daarbuiten.Researchers